(三)信息论

(1)信息论的产生和发展

20世纪初以来,特别是20世纪40年代,通信技术的迅速发展,迫切需要解决一系列信息论问题,如如何从接收的信号中滤除各种噪声,怎样解决火炮自动控制跟踪目标问题等。这促使人们开始对信息问题进行研究,以便揭示通信过程的规律和重概念的本质。1948年,美国应用数学家申农在《贝尔系统技术杂志》上发表重要论文《在噪声中的通信》。在这些论文里,申农提出了通信系统模型、度量信息数学公式以及编码定理和其他一些技术性问题的解决方案。

20世纪70年代以来,信息在两个方面有了新的进展。1971年,高艾斯等人提出了“有效信息”的概念。1978年,夏尔马等人提出了“广义的有效信息”等概念。此外,还有人提出“语义信息”、“相对信息”、“模糊信息”等概念。

信息科学是一门综合学科。目前,信息科学包含有信息论、控制论、仿生学、人工智能、计算机和系统工程等方面的内容,并正在飞速发展。

(2)信息概念

关于信息的定义,不同的信息理论有不同的表述。以申农的信息论和维纳的控制论为代表的技术信息理论,则把信息概念区分为广义的和狭义的。狭义的信息是指具有新的内容、新知识的消息(如书信、情报、指令等);广义的信息是指系统内部建立联系的特殊形式,是系统确定程度(即特殊程度、组织程度或者有序程度)的标记。

关于信息的本质,这仍是一个需要进一步探讨的问题。对信息本质的探讨使人们认识到:信息是用来表征事物的,是由事物发出的消息、情报、指令、数据、信号中所包含的东西。信息既不同于物质和能量,又与物质和能量有密切的关系。任何物质都具有作为信息源的属性,只要存在的东西是物质,它必然向外发送信息。信息的传递要依赖物质,信息的储存也只有借助物质才能实现。信息本身不等同于能量,但获取信息要消耗能量,驾驭能量又需要信息,二者紧密联系在一起。

(3)信息量与信息系统

在技术信息理论中,度量信息的基本出发点,是把信息作为用来消除“不确定性”的东西。由于熵在热力学中表示系统的无组织程度即不确定性程度,而信息量是表示消除不确定的量即反映系统的确定程度,因此信息是一种负熵。

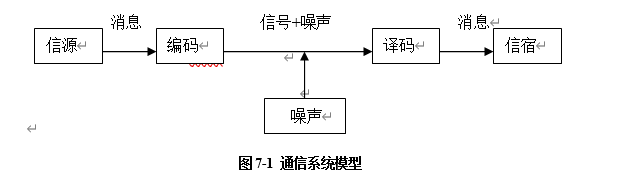

申农在1945年提出的通信系统模型如下图所示。

实际的通信系统要复杂得多,但都有上述五个基本部分。申农的通信模型不仅适用于通信系统,还可以推广到其他非通信领域,推广到各种各样的信息系统,如遥测系统、遥感系统、计算机系统、控制系统、管理系统等等。由此可见,申农的通信系统模型可作为一般的信息系统模型。

(4)信息方法

所谓信息方法,就是运用信息的观点,把系统看作是借助于信息的获取、传送、加工、处理而实现其有目的性的运动的一种研究方法。这种方法的特点是“用信息概念作为分析和处理问题的基础;完全撇开对象的具体运动形态,把系统的运动过程抽象为信息的转换过程,信息概念向各门学科的广泛渗透,是同信息方法的推广应用联系在一起的。例如,当信息概念向生物学领域渗透时,用信息方法来说明遗传现象就取得很好的效果。